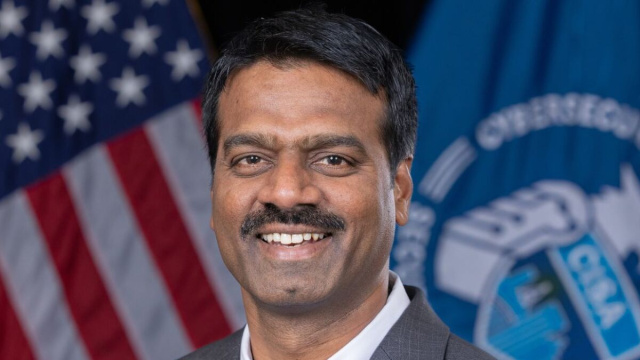

Il 28 gennaio 2026 è emersa una vicenda che intreccia intelligenza artificiale e governance della cybersicurezza. Madhu Gottumukkala, direttore ad interim della Cybersecurity and Infrastructure Security Agency (CISA), ha caricato documenti contrattuali contrassegnati “for official use only” su una versione pubblica di ChatGPT. Questo ha sollevato seri interrogativi sul rispetto delle regole interne e sulla protezione delle informazioni governative.

Contesto e dinamica dell’evento

Secondo le prime ricostruzioni, Gottumukkala ha caricato materiali sensibili ma non classificati — documenti con limitazioni d’uso, ma non riservati — su ChatGPT nel corso dell’estate 2025.

Ciò è avvenuto dopo aver ottenuto un’eccezione temporanea al blocco imposto a molti dipendenti del Department of Homeland Security (DHS) sull’uso della piattaforma AI. Nonostante la natura non classificata dei documenti, il loro caricamento su un servizio pubblico ha fatto scattare molteplici avvisi dai sistemi di sicurezza di CISA, progettati per evitare fughe accidentali o intenzionali di informazioni.

Reazione e indagine interna

L’attività sospetta ha scatenato una revisione interna a livello del DHS, con la partecipazione di alti funzionari. L’avvocato generale ad interim Joseph Mazzara e il Chief Information Officer Antoine McCord sono stati incaricati di valutare il potenziale impatto per la sicurezza nazionale e le possibili violazioni disciplinari.

CISA, tramite la portavoce Marci McCarthy, ha precisato che l’utilizzo di ChatGPT da parte di Gottumukkala è stato “a breve termine e limitato”, svolto con controlli DHS in atto. L’agenzia ha contestato alcune tempistiche riportate, affermando che l’ultimo accesso risalirebbe alla metà di luglio 2025, nell’ambito dell’eccezione concessa a pochi soggetti.

Criticità dell’uso di piattaforme pubbliche di AI

La scelta di utilizzare ChatGPT pubblico espone numerose criticità operative e di sicurezza. Tutto ciò che viene immesso può essere utilizzato per addestrare il modello e potenzialmente emergere in risposte fornite ad altri utenti. In contrasto, strumenti come il chatbot interno del DHS, DHSChat, sono progettati per mantenere i dati all’interno dei confini federali, senza che informazioni sensibili escano dalla rete governativa.

Un profilo controverso e questioni di leadership

Gottumukkala, che guida CISA dal maggio 2025 in qualità di ad interim, è già al centro di altre tensioni interne. Tra queste, un controverso test poligrafico che avrebbe fallito, e una conseguente sospensione di sei membri del personale di carriera per aver partecipato a un esame “non autorizzato”. Questi episodi amplificano i dubbi su stabilità, giudizio e governance nell’agenzia incaricata della difesa delle infrastrutture critiche del Paese, in una fase di forte spinta verso l’adozione dell’intelligenza artificiale a scopo governativo.

Il caso evidenzia un paradosso serio: l’autorità centrale in tema di cybersecurity ha violato principi basilari di protezione delle informazioni, utilizzando un servizio esterno con potenziali riflessi sulla privacy nazionale.

Le policy esistenti sembrano non aver impedito la circostanza, suggerendo limitazioni nei sistemi di controllo e supervisione, oltre a individuare una discrepanza tra le regole formali e la loro applicazione in situazioni eccezionali.

Nell’epoca della digitalizzazione accelerata e dell’adozione dell’AI nei contesti pubblici, il tema della protezione dei dati sensibili è cruciale. Occorre rafforzare le barriere tra sistemi pubblici e reti governative, rivedere i processi autorizzativi e garantire che anche figure di massimo livello siano soggette a valutazioni rigorose. Se il capo della cybersicurezza utilizza un servizio pubblico per trattare documenti ufficiali, significa che le garanzie non reggono.

Serve un approccio coerente e strutturato: rafforzare le piattaforme AI interne, estendere formazione e consapevolezza al personale di alto profilo, e rendere trasparenti le conseguenze di possibili infrazioni. Solo così si potrà recuperare credibilità nel momento in cui affidiamo alle tecnologie emergenti anche la protezione della democrazia e delle infrastrutture critiche.