L’ultimo rapporto annuale dell’istituto Human‑Centered Artificial Intelligence (HAI) della Stanford University, pubblicato lunedì 13 aprile 2026, rivela un divario culturale crescente tra gli addetti ai lavori dell’intelligenza artificiale e la percezione che ne ha il pubblico. Mentre gli esperti guardano al futuro con cauto ottimismo, l’opinione pubblica esprime preoccupazioni concrete su settori chiave come il lavoro, la sanità e l’economia.

Percezione pubblica e visione degli esperti

Il report evidenzia come solo il 10% degli americani si dichiari più entusiasta che preoccupato dall’uso diffuso dell’IA nella vita quotidiana.

Al contrario, il 56% degli esperti ritiene che l’IA avrà un impatto positivo sugli Stati Uniti nei prossimi vent’anni. Le differenze sono ancora più marcate a livello settoriale: per la sanità, l’84% degli esperti prevede effetti benefici, contro appena il 44% del pubblico. Sul fronte occupazionale, il 73% degli esperti si aspetta un impatto positivo, rispetto al solo 23% del pubblico. Analogamente, per l’economia, il 69% degli esperti è ottimista, mentre solo il 21% del pubblico condivide questa visione. In parallelo, il 64% degli americani teme che l’IA possa portare a una riduzione dei posti di lavoro, riflettendo un sentimento comune di scetticismo rispetto alle promesse tecnologiche.

Ansia crescente e fiducia nella regolamentazione

Il rapporto attesta un aumento della sensazione di ansia nei confronti dell’IA: la percentuale di persone che si dichiarano “nervose” per l’intelligenza artificiale è salita dal 50% nel 2024 al 52% nel 2025. Questo incremento si registra nonostante un lieve miglioramento nella percezione dei benefici complessivi, passata dal 55% al 59% nello stesso periodo. Sul piano della fiducia nelle istituzioni, gli Stati Uniti si posizionano in fondo alla classifica: solo il 31% degli americani crede che il proprio governo sia in grado di regolare responsabilmente l’IA, mentre Singapore raggiunge un notevole 81%. Inoltre, il 41% degli intervistati ritiene che la regolamentazione federale non sarà sufficiente, mentre solo il 27% la considera eccessiva.

Investimenti e sentiment globale sull'IA

Un’analisi comparativa offre un contesto più ampio, mettendo in rilievo un investimento record in IA: oltre 581 miliardi di dollari nel 2025, con gli Stati Uniti che si confermano leader indiscussi. Al contempo, la percezione pubblica globale appare eterogenea. Pur con un lieve miglioramento generale nel riconoscimento dei benefici netti (dal 55% al 59%), la fiducia nella regolamentazione governativa rimane bassa negli Stati Uniti (31%).

Dinamiche globali e differenze geografiche

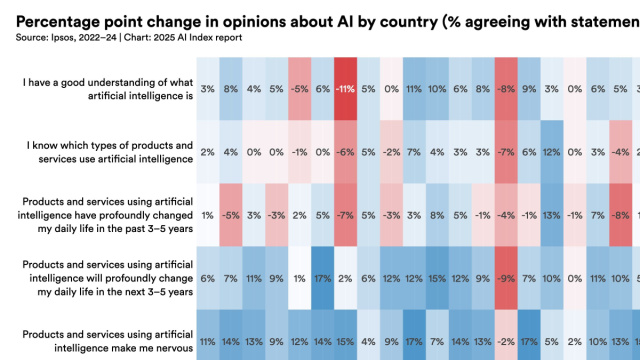

Il sentimento verso l’intelligenza artificiale non è uniforme a livello mondiale. In alcuni Paesi del sud-est asiatico, tra cui Cina, Malesia, Thailandia, Indonesia e Singapore, l’atteggiamento è nettamente più positivo.

In Europa, Francia, Germania e Paesi Bassi mostrano i maggiori incrementi positivi anno su anno (con aumenti del 10% e oltre), mentre Paesi come la Colombia registrano un’inversione di tendenza negativa. La fiducia nella capacità dei governi di regolamentare efficacemente l’IA varia in modo significativo: Singapore si attesta all’81%, mentre gli Stati Uniti rimangono sotto soglia, oscurati anche da Paesi europei che stanno costruendo fiducia attraverso approcci normativi più solidi.

Verso un allineamento tra pubblico ed esperti?

Il divario identificato dal rapporto Stanford rivela una sfida strutturale: gli esperti si confrontano su scenari evolutivi e sull’Intelligenza Artificiale Generale (AGI), mentre il pubblico vive le ricadute tangibili della tecnologia.

Questo disallineamento rischia di produrre politiche normative frammentate e una fiducia sempre più evanescente. Il dato secondo cui il 41% del pubblico ritiene insufficiente la regolamentazione attuale è emblematico di questa tensione.

Colmare questo gap richiede trasparenza, educazione pubblica mirata e un coinvolgimento attivo nei processi decisionali. In assenza di queste azioni, la tensione tra entusiasmo professionale e ansia sociale rischia di consolidarsi e crescere, compromettendo l'adozione responsabile dell'IA.

Riconciliare la visione degli esperti con le paure e le aspettative diffuse non è solo una questione comunicativa, ma una condizione essenziale per costruire una società in cui l’intelligenza artificiale sia percepita non solo come una promessa, ma come uno strumento affidabile, equo e condiviso.