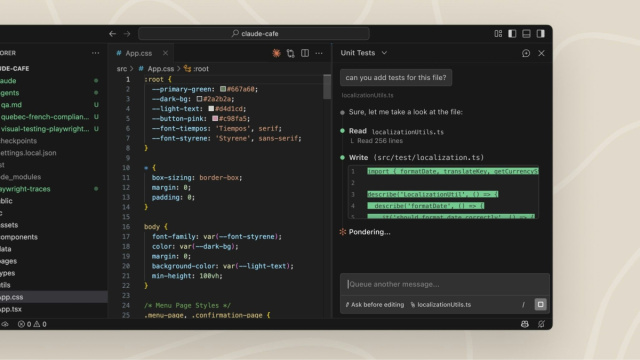

Anthropic introduce una significativa novità per gli sviluppatori che utilizzano Claude Code: la “modalità automatica” (auto mode). Questa funzione, attualmente in anteprima di ricerca e presentata il 24 marzo 2026, permette all’intelligenza artificiale di valutare autonomamente le azioni sicure e di bloccare direttamente quelle potenzialmente rischiose, come i tentativi di injection nei prompt, senza richiedere l’approvazione esplicita dell’utente.

Funzionamento e Logica dell’Auto Mode

L’auto mode si propone come un equilibrio tra sicurezza e produttività.

Sostituisce il precedente comando “dangerously‑skip‑permissions” introducendo una logica interna avanzata per la valutazione del rischio. Quando la modalità è attiva, Claude Code è in grado di decidere se approvare autonomamente comandi considerati semplici, come l’editing di file o l’esecuzione di script benigni, e di bloccare azioni sospette, il tutto senza la necessità di un intervento umano.

Attivazione, Compatibilità e Raccomandazioni

L’attivazione dell’auto mode avviene tramite il comando da CLI claude --enable-auto-mode. Questa funzionalità è pensata per gli utenti Enterprise e per le integrazioni via API, ed è al momento compatibile esclusivamente con i modelli Claude Sonnet 4.6 e Opus 4.6.

Anthropic raccomanda vivamente di utilizzare questa modalità in ambienti isolati o sandbox per minimizzare eventuali esposizioni e potenziali rischi.

Vantaggi Operativi e Considerazioni sui Costi

Con l’introduzione dell’auto mode, Anthropic risponde all’esigenza crescente di maggiore automazione nelle sessioni di coding più lunghe e complesse, riducendo le interruzioni dovute alle approvazioni manuali. Tuttavia, è importante considerare che il processo di valutazione autonoma comporta un aumento del consumo di token, una maggiore latenza e, di conseguenza, un costo operativo superiore per ogni singola operazione.

Controlli di Gestione e Protezioni Integrate

Per le organizzazioni, l’auto mode è dotata di specifici controlli gestionali: può essere disabilitata attraverso policy MDM o configurazioni di sistema, ad esempio tramite impostazioni su Jamf per macOS o Group Policy/Intune per Windows.

La funzione integra inoltre protezioni avanzate contro il prompt injection, un meccanismo cruciale per prevenire attacchi nascosti all’interno di file o output potenzialmente pericolosi.

Verso l’Autonomia dell’IA nel Coding: Un Trend di Settore

L’introduzione dell’auto mode si inserisce in una tendenza più ampia che vede gli strumenti di intelligenza artificiale diventare sempre più agentici e operare con maggiore indipendenza nel campo del coding. Modelli come Opus 4.6, rilasciato a febbraio 2026 con un contesto di memoria fino a un milione di token, sono progettati per supportare scenari in cui l’IA gestisce intere basi di codice in sessioni di lavoro prolungate. Funzionalità evolute, come le applicazioni auto-costruite da Claude Code denominate Cowork, stanno già contribuendo a una maggiore adozione di questi strumenti in contesti non tradizionali.

Questa crescente autonomia richiede un attento bilanciamento tra efficienza operativa e la necessità di mantenere controlli rigorosi. Senza meccanismi di governance robusti, un’eccessiva fiducia nell’IA potrebbe potenzialmente condurre a errori, vulnerabilità o un allontanamento dalle pratiche di sicurezza consolidate. Con questa innovazione, Anthropic mira ad ampliare i confini dell’autonomia operativa, pur mantenendo saldamente le redini del sistema nelle mani dell’utente o dell’organizzazione.

In sintesi, l’auto mode rappresenta un passo significativo nel percorso di evoluzione degli strumenti AI per sviluppatori, offrendo un maggiore equilibrio tra automazione e controllo. Permette di snellire i flussi di lavoro e di delegare decisioni non rischiose all’IA, garantendo al contempo il mantenimento di politiche di sicurezza e una supervisione sia tecnicamente che eticamente appropriate.