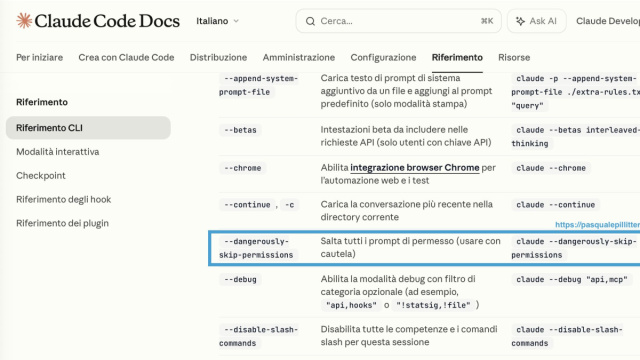

Anthropic ha introdotto una novità significativa per Claude Code: l’auto mode, una modalità sperimentale che mira a ridefinire l’interazione tra sviluppatori e intelligenza artificiale. In un panorama dove lo sviluppo assistito da IA evolve verso una maggiore autonomia, questa funzione permette a Claude di decidere autonomamente quali azioni autorizzare, senza interrompere il flusso di lavoro, pur rimanendo vincolato da robuste misure di sicurezza. L’obiettivo è superare il modello di “vibe coding”, dove lo sviluppatore è costretto a monitorare costantemente l’IA, riducendo al contempo la dipendenza da soluzioni estreme e prive di sicurezza come il comando --dangerously-skip-permissions.

Questa innovazione riflette una tendenza più ampia nel settore, dove gli strumenti di intelligenza artificiale sono sempre più progettati per agire senza attendere l’approvazione umana. La sfida principale rimane bilanciare la velocità operativa con il controllo: troppe restrizioni rallentano i processi, mentre troppe poche possono rendere i sistemi rischiosi e imprevedibili. L’auto mode di Anthropic, attualmente in research preview – il che significa che è disponibile per test ma non è ancora un prodotto finito – rappresenta l’ultimo tentativo di trovare questo delicato equilibrio.

Come funziona la modalità automatica

La nuova modalità consente a Claude di eseguire autonomamente le azioni che ritiene sicure, mentre le operazioni sospette vengono bloccate.

Un classificatore interno, basato su salvaguardie AI, valuta ogni azione prima che venga eseguita, cercando comportamenti rischiosi non richiesti dall’utente e segnali di prompt injection. Quest’ultima è una tipologia di attacco in cui istruzioni dannose sono nascoste nel contenuto elaborato dall’IA, inducendola a compiere azioni indesiderate. Le azioni sicure procedono automaticamente, mentre quelle a rischio vengono bloccate, estendendo di fatto il comando esistente dangerously-skip-permissions di Claude Code, ma con un livello di sicurezza aggiuntivo.

Per attivare l’auto mode, gli sviluppatori devono eseguire il comando claude --enable-auto-mode. Anthropic raccomanda di utilizzare questa funzione in ambienti isolati, come sandbox o macchine virtuali, per limitare eventuali danni nel caso qualcosa andasse storto.

Tuttavia, non sono stati ancora resi pubblici i criteri dettagliati che il sistema utilizza per distinguere le azioni sicure da quelle a rischio, un aspetto che gli sviluppatori vorranno probabilmente comprendere meglio prima di adottare ampiamente la funzionalità.

Controllo amministrativo e impatto

Anche se Claude assume molte decisioni autonomamente, Anthropic ha previsto margini di controllo per le infrastrutture IT. Le organizzazioni possono disabilitare l’auto mode tramite policy MDM (come Jamf o Intune) o configurazioni di sistema, mantenendo un livello centralizzato di governance. Questa funzionalità si basa su una serie di strumenti di codifica autonomi di aziende leader nel settore, ma si spinge oltre, spostando la decisione di chiedere il permesso dall’utente all’IA stessa.

L’introduzione dell’auto mode segue il debutto di altri strumenti di automazione di Anthropic, come Claude Code Review, un revisore automatico del codice progettato per individuare bug prima che entrino nella codebase, e Dispatch for Cowork, che permette agli utenti di inviare compiti ad agenti AI per la gestione del lavoro. La modalità automatica sarà inizialmente disponibile per gli utenti Enterprise e API, oltre che per il piano Team, nei giorni successivi al lancio ufficiale. Attualmente, funziona solo con Claude Sonnet 4.6 e Opus 4.6.

Un’alternativa equilibrata

L’auto mode si propone come una valida via di mezzo tra il fastidio delle continue interruzioni per ogni richiesta di permesso e il rischio di offrire all’IA un controllo completo e senza filtri.

Blocca le operazioni sospette senza richiedere conferme manuali costanti, allineandosi con la tendenza generale verso strumenti di intelligenza artificiale sempre più autonomi, ma con un’attenzione particolare alla sicurezza.

Riscontri dalla community

Nei forum dedicati a Claude Code, alcuni utenti hanno segnalato difficoltà nell’effettiva disponibilità della funzione, riferendo l’errore “Auto Mode temporarily unavailable” all’attivazione. Inoltre, la percezione emergente tra gli utilizzatori riguarda un potenziale aumento dei costi e della latenza dovuti ai controlli aggiuntivi implementati, oltre a una certa opacità nei criteri adottati dalla modalità per distinguere le azioni sicure da quelle rischiose.

Prospettive future e tendenze

La direzione intrapresa con l’auto mode riflette un trend più ampio: l’intelligenza artificiale in grado di operare con autonomia crescente, mantenendo al contempo saldo il controllo umano sui rischi. Questo aspetto è cruciale in contesti aziendali, dove la velocità di esecuzione e la sicurezza dei sistemi devono coesistere in modo efficace. Se implementato e comunicato correttamente, Claude potrà evolvere in un partner più capace e responsabile, libero di agire ma anche più prevedibile nei suoi processi.

Il successo futuro di questa innovazione dipenderà in larga misura da come Anthropic comunicherà i criteri di sicurezza adottati e dallo sviluppo della fiducia nella capacità dell’intelligenza artificiale di autogovernarsi, preservando la responsabilità e la prevedibilità delle operazioni.