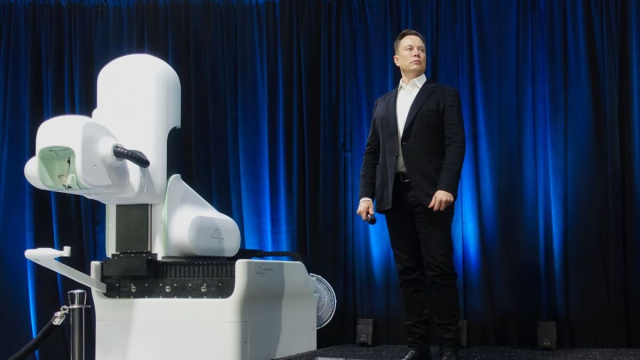

Elon Musk ha lanciato un messaggio criptico su X il 28 gennaio 2026: “Edited visuals warning”. Questo annuncio, rilanciato da un post anonimo dell’account DogeDesigner, anticipa l’arrivo di un sistema destinato a etichettare come “manipulated media” le immagini che sono state modificate. La notizia solleva interrogativi significativi sui criteri che verranno adottati per l’identificazione — in particolare se tali criteri comprenderanno anche le modifiche tradizionali, come quelle realizzate con software di fotoritocco — e sui meccanismi di tutela previsti per gli utenti della piattaforma.

Il contesto: etichettare anziché rimuovere

La strategia annunciata da Musk richiama le linee guida che erano state precedentemente messe a punto da Twitter, prima della sua acquisizione. Già nel 2020, Yoel Roth aveva indicato che Twitter procedeva a segnalare i media manipolati o fuorvianti anziché eliminarli. Questa politica includeva la segnalazione di editing selettivo, doppiaggio audio o manipolazione dei sottotitoli. Tuttavia, resta da chiarire se X intenda mantenere la medesima definizione di “manipulated media” o se la amplierà, includendo, ad esempio, le modifiche operate attraverso strumenti di intelligenza artificiale generativa.

Il problema dei falsi positivi e le esperienze delle altre piattaforme

Piattaforme come Meta hanno già dovuto confrontarsi con il paradosso dei falsi positivi. Il loro sistema di rilevamento ha erroneamente etichettato fotografie del tutto inalterate come “Made with AI”, a causa di procedure tecniche standard come la conversione in formato JPEG o l’uso di strumenti specifici. Di conseguenza, anche X potrebbe trovarsi ad attivare avvisi non necessari qualora il sistema non fosse in grado di differenziare con la dovuta attenzione il tipo di editing applicato.

Standard emergenti e iniziative di trasparenza

A livello globale, sono in corso diverse iniziative volte a garantire la provenienza e l’autenticità dei contenuti digitali.

Tra queste figurano la C2PA (Coalition for Content Provenance and Authenticity), la Content Authenticity Initiative e Project Origin. Queste organizzazioni mirano a integrare metadati certificati che attestino le modifiche apportate o l’eventuale generazione artificiale di un contenuto. Al momento, X non risulta tra i membri attivi di queste coalizioni, sebbene siano in corso verifiche per eventuali aggiornamenti.

Quali dubbi restano aperti

Il comunicato diffuso non fornisce risposte su aspetti di fondamentale importanza. Quali tecnologie verranno impiegate per il riconoscimento dei contenuti manipolati? Si farà ricorso all’analisi tramite intelligenza artificiale, all’analisi dei metadati, o ci si affiderà al crowdsourcing, come avviene con Community Notes?

Inoltre, è previsto un sistema che consenta agli utenti di contestare le etichettature?

Implicazioni sull’informazione e l’affidabilità

Su una piattaforma come X, che è stata teatro di episodi di disinformazione e propaganda, l’etichettatura metodica delle immagini alterate potrebbe rappresentare un passo avanti verso una maggiore responsabilità editoriale. L’efficacia di tale sistema dipenderà, tuttavia, dalla precisione con cui opererà e dalla trasparenza delle regole che verranno applicate. In assenza di dettagli operativi, resta cruciale monitorare attentamente come X definirà il concetto di “manipulated media”, come eviterà errori di valutazione, come si allineerà agli standard internazionali e come tutelerà il diritto degli utenti a correggere eventuali inesattezze.

La proposta evidenzia una tensione crescente tra l’esigenza di contrastare la manipolazione informativa online e la necessità di garantire accuratezza e correttezza algoritmica. Le prossime settimane saranno decisive per comprendere se X riuscirà a tradurre questo avviso criptico in un sistema credibile, efficace e trasparente, a difesa sia della veridicità dei contenuti sia della fiducia degli utenti.